Wird Facebook bald Wahlen entscheiden?

Das Schreckensszenario einer digitalen Wahlbeeinflussung – und was wir dagegen tun können.

Am 2. November 2010 sind die amerikanischen Nutzer von Facebook einem ehrgeizigen Social-Engineering-Experiment unterworfen worden: War es möglich, Wahlfaule in den USA mit Hilfe von Social Media dazu zu bekommen, bei den Halbzeitwahlen am selben Tag ihre Stimme abzugeben? Die Antwort lautete: Ja.

Der Trick, um die Leute in die Wahlkabinen zu lotsen, war denkbar schlicht. Er bestand aus einer Grafik, die einen Link enthielt, mit Hilfe dessen sich Wahllokale ausfindig machen liessen, dazu einen Button, den man anklickte, um zu zeigen, dass man abgestimmt hatte, sowie Profilfotos von bis zu sechs Facebook-Freunden, die bekanntgaben, dass sie dies ebenfalls getan hatten. In Zusammenarbeit mit Facebook platzierten die Politologen, die die Studie entworfen hatten, diese Grafik im Newsfeed von zig Millionen Nutzern (andere Gruppen von Facebook-Nutzern bekamen eine generische Wahlaufforderung oder auch gar keine). Mit gewaltigem Rechenaufwand glichen nun die Forscher die Namen der Versuchspersonen mit den tatsächlichen Wahldaten aus Bezirken überall im Land ab, um den Effekt ihrer Massnahme zu ermitteln.

Im Gesamtergebnis gingen Nutzer, denen angezeigt worden war, dass ihre Freunde abgestimmt hatten, mit um 0,39 Prozent grösserer Wahrscheinlichkeit zur Wahl als die Kontrollgruppe. Ihre Entscheidung, zur Wahl zu gehen, schien sich wiederum auf das Verhalten ihrer engeren Facebook-Freunde auszuwirken, selbst wenn diese die ursprüngliche Grafik nicht erhalten hatten. Jener kleine Anstieg in der Wählerquote bedeutete in absoluten Zahlen eine grosse Menge zusätzlicher Stimmen. Die Forscher folgerten, dass ihre Intervention auf Facebook 60 000 Wähler unmittelbar mobilisiert hatte. 340 000 weitere Wähler waren als Folge des sogenannten Ripple-Effekts an die Urnen gebracht worden. Wie die Forscher betonen, entschied George W. Bush seinerzeit die Abstimmung in Florida – und in der Folge das Rennen um die Präsidentschaft – mit einem Vorsprung von 537 Stimmen für sich – sprich mit weniger als 0,01 Prozent aller in Florida abgegebenen Stimmen.

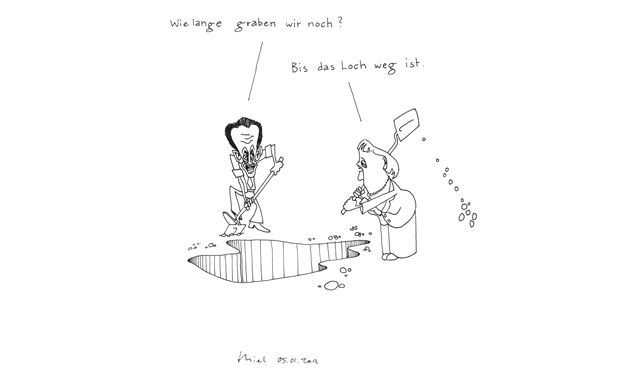

Nehmen wir nun versuchsweise an, dass dereinst bei einer heissumkämpften Wahl Mark Zuckerberg einen bestimmten Kandidaten favorisiert. Er sorgt dafür, dass zig Millionen aktive Facebook-Nutzer eine Wahlaufforderung in ihren Newsfeed eingespielt bekommen – anders jedoch als im oben beschriebenen Experiment erfolgt die Auswahl jener Nutzer, die keine Aufforderung erhalten, nicht auf Zufallsbasis. Stattdessen macht sich Zuckerberg den Umstand zunutze, dass Facebook-Likes auf die jeweiligen politischen Ansichten oder auf die Zugehörigkeit zu einer politischen Partei hindeuten – ganz abgesehen davon, dass viele Nutzer ihre politischen Präferenzen ohnehin explizit machen. Also verzichtet unser hypothetischer «Zuck» darauf, solche Nutzer zum Wählen aufzufordern, die seinem Kandidaten gegenüber eher negativ eingestellt sind. Infolge dieser Machenschaften fällt das Wahlergebnis zu seinen Gunsten aus. Sollte der Gesetzgeber derartigem Verhalten einen Riegel vorschieben?

Subtile Manipulation ohne Gegenreaktion möglich

Das hier dargestellte Szenario illustriert die Möglichkeiten digitaler Wahlbeeinflussung. Eine Vielzahl verschiedenster Faktoren entscheidet darüber, was wir in unseren Facebook- oder Twitter-Feeds angezeigt bekommen oder was Google oder Bing uns als Suchergebnisse anzeigen. Unsere Erwartung ist, dass uns diese Informationsvermittler zu den Inhalten Dritter bringen und dass uns die Variablen in ihren Prozessen lediglich helfen, diejenige Information zu finden, die uns am relevantesten scheint. In ähnlicher Weise erwarten wir von sogenannten Sponsored Links, dass sie deutlich als kommerzielle Angebote gekennzeichnet sind, so dass wir sie von normalen Links unterscheiden können. Digitale Wahlbeeinflussung findet statt, wo eine Website Informationen stattdessen so präsentiert, dass sie eine bestimmte ideologische Agenda unterstützen. Diese Möglichkeit besteht im Prinzip bei allen Onlineangeboten, die Nutzern auf deren Präferenzen zugeschnittene Inhalte anzeigen, und ist zunehmend leichter umzusetzen.

Es gibt zwar mehr als genug Gründe, in digitaler Wahlbeeinflussung ein äusserst toxisches Unterfangen zu sehen, mit dem sich kein vernünftiges Unternehmen abgeben würde. Keiner der genannten Anbieter jedoch verspricht hinsichtlich seiner proprietären Algorithmen Neutralität – was auch immer das in der Praxis heissen würde. Auch haben sie bereits ihre Bereitschaft unter Beweis gestellt, ihre famosen Plattformen zu Zwecken der politischen Manipulation einzusetzen. Im Januar 2012 beispielsweise schwärzte Google das «Doodle» auf seiner Homepage ein, um so gegen das anhängige Stop-Online-Piracy-Gesetz SOPA zu protestieren, das, wie seine Gegner (unter ihnen ich selbst) behaupteten, Zensurmassnahmen erleichtern würde. Das geschwärzte Logo war mit einem offiziellen Blogeintrag verlinkt, der Google-Nutzer drängte, eine Eingabe beim US-Kongress zu machen. Letztlich kam SOPA nicht durch – so wie es Google und mancher andere gewollt hatten. Ein Social-Media- oder Suchmaschinenunternehmen mit der Absicht, einen Schritt weiter zu gehen und auf ein ihm genehmes Wahlergebnis hinzuwirken, hätte aber zweifellos die Mittel dazu.

Was nun steht einem solchen Versuch im Wege? Die wichtigste Absicherung ist das Drohszenario, in dem sich eine signifikante Anzahl Nutzer aus Empörung über einen Vertrauensbruch des einen Anbieters von diesem ab- und einem anderen zuwendet, was einen Umsatz- und Reputationsverlust für das verantwortliche Unternehmen bedeuten würde. Während aber etwa Googles Propaganda-Doodle oder ähnliche ideologisch motivierte Veränderungen an bekannten Homepages für jedermann offensichtlich sind, gibt es für Newsfeeds oder Suchergebnisseiten keine feste Ausgangsversion: Sie lassen sich subtil anpassen, ohne eine Gegenreaktion wie die oben beschriebene zu riskieren. Ja in unserem Gedankenexperiment haben letztlich diejenigen Nutzer den meisten Grund zur Klage, die eben keine Wahlaufforderung in ihren Newsfeed eingespielt bekommen und womöglich nie von deren Existenz erfahren. Mehr noch: in ihren Datenschutzerklärungen behalten sich Social Media und Suchmaschinen bereits das Recht vor, ihre Newsfeeds oder Suchergebnisse nach Gutdünken zu manipulieren. In diesem Sinne wäre ein Versuch, die Wahlbeteiligung gezielt zu beeinflussen, bereits von den existierenden Einverständniserklärungen abgedeckt und bedürfte keiner weiteren Mitteilung an den Nutzer.

Ungeachtet dessen wäre es wenig sinnvoll, dem Szenario einer digitalen Wahlbeeinflussung mit neuen Gesetzen zu begegnen. Wohl muss dem Anspruch der Bürger auf einen demokratisch einwandfreien Wahlvorgang Genüge getan werden. Andererseits dürfen Anbieter ihre Inhalte gemäss ihren Grundrechten nach dem 1. Zusatzartikel der amerikanischen Verfassung darstellen, wie sie möchten. Sich in die Art und Weise einzumischen, wie ein Unternehmen seinen Kunden Informationen präsentiert – besonders, wo die Richtigkeit der fraglichen Informationen nicht einmal bezweifelt wird –, ist ein heikles Unterfangen. (Das ist übrigens einer der Gründe, warum der Europäische Gerichtshof die Sache falsch verstand, als er Personen die Handhabe gab, Suchergebnisse mit ihrem Namen zu zensurieren, und damit das sogenannte «Recht auf Vergessenwerden» für gültig erklärte.)

Die Lösung: Informationstreuhänder

Es gibt tatsächlich eine bessere Lösung: Man könnte Onlineunternehmen, denen Nutzer persönliche Daten und Präferenzen anvertrauen, dazu bringen, hinsichtlich dieser Information als Treuhänder zu agieren. Ein Befürworter dieses Ansatzes ist Jack Balkin von der Yale Law School. Balkin vergleicht die Lage der Onlineanbieter mit jener von Anwälten und Ärzten, die ebenfalls von ihren Klienten bzw. Patienten mit sensiblen Informationen betraut werden, diese aber nicht zweckentfremden dürfen. Balkin fragt: «Sollten wir bestimmte Onlineanbieter aufgrund ihrer Bedeutung für das Leben der Menschen und aufgrund des Ausmasses an Vertrauen, das diese ihnen nolens volens entgegenbringen müssen, in ähnlicher Weise behandeln?»

Wie die Sache steht, sind Onlineanbieter lediglich verpflichtet, ihre eigenen Datenschutzbestimmungen zu befolgen, wie fadenscheinig diese auch sein mögen. Informationstreuhänder müssten durchaus mehr leisten. Beispielsweise könnte man sie zur automatischen Dokumentation verpflichten, so dass sich nachvollziehen liesse, ob und wo sie die persönlichen Informationen ihrer Nutzer zweckentfremden oder mit anderen Unternehmen teilen. Für eine solche Funktion liesse sich übrigens die Art Register, mit der Kryptowährungen wie Bitcoin Transaktionen verfolgen, nutzbar machen. Auch würden Informationstreuhänder ihren Nutzern ermöglichen, sich Suchergebnisse oder Newsfeeds so anzeigen zu lassen, wie sie im nichtpersonalisierten Zustand aussähen, sprich ohne den Einfluss unzähliger persönlicher Informationen. Nicht zuletzt würden Informationstreuhänder ausdrücklich darauf verzichten, persönliche Informationen von Nutzern für ihre eigenen ideologischen Zwecke zu missbrauchen. Ein solches System könnte auf Freiwilligkeit beruhen – so wie sich Finanzexperten für eine Karriere als Investmentberater oder als Börsenmakler entscheiden können: Als Berater sind sie in der Pflicht, ihre eigenen Interessen nicht über die ihrer Klienten zu stellen; als Makler unterliegen sie keiner solchen Verpflichtung. (Wenn Ihnen jemand erzählt, wie Sie Ihr Erspartes anlegen sollen, tun Sie gut daran, ihn als erstes zu fragen, ob er als Ihr Treuhänder agiere, und wenn nicht, schnellstens das Weite zu suchen.)

Man müsste den Pflichtenkatalog eines Informationstreuhänders mit Blick auf die Anbieter so zurückhaltend formulieren, mit Blick auf die Nutzer aber zugleich so vorteilhaft, dass die Anbieter dazu gebracht werden können, ihn zu akzeptieren. Die Regierung könnte Anbietern, die sich bereit finden, ihren Nutzern einen derart vermehrten Schutz ihrer persönlichen Informationen zuzusichern, Steuererleichterungen oder bestimmte rechtliche Immunitäten in Aussicht stellen. Auch dann noch können meine Newsfeeds und meine Suchergebnisse anders aussehen als Ihre, je nach unserer jeweiligen politischen Präferenz, jedoch nur deshalb, weil der Algorithmus jedem von uns gibt, was er will – so wie ein Anlageberater seinen waghalsigen Klienten zu Aktien, seinen zaghaften Klienten aber zu Anleihen rät –, nie jedoch, weil ein Onlineanbieter heimlich Wahlen zugunsten seines Favoriten zu beeinflussen versucht.

Vor vierzig Jahren war es eine andere junge Technologie, von der Amerikaner befürchteten, sie könnte zur Manipulation eingesetzt werden: 1974 machte sich Panik breit ob der angenommenen Möglichkeit unterschwelliger, in Fernsehwerbung eingebetteter Botschaften, und die Federal Communications Commission reagierte prompt mit einem Verbot solcher Praktiken. Diese Entscheidung war wohlbegründet: Die Sendeanstalten haben sich, so das historisch gewachsene Rollenverständnis, im Austausch für das Recht zur Nutzung öffentlicher Frequenzen zur Objektivität verpflichtet. Dieselbe Verpflichtung auf die Interessen des Publikums sollte auch für das beherrschende Medium unserer Zeit gelten. Mehr und mehr von dem, was unsere Ansichten und unser Verhalten formt, entstammt undurchschaubaren, computerisierten Prozessen. Daher gilt es die damit verbundenen Gefahren verlässlich einzuhegen, wenn auch so, dass nicht unversehens eine Einschränkung des Grundrechts auf freie Meinungsäusserung dabei herauskommt. Unsere Informationsvermittler dürfen ihre Rezepturen durchaus geheim halten, wobei sie zwangsläufig bestimmte Inhaltsquellen bevorteilen, andere wiederum benachteiligen; bei alledem müssen sie aber anerkennen, dass bestimmte Zutaten giftig sind – und vom Tisch gehören.